DeepSeek探索出一条“算法创新+有限算力”的新路径,开源AI时代或已至,国产AI估值或将重塑。

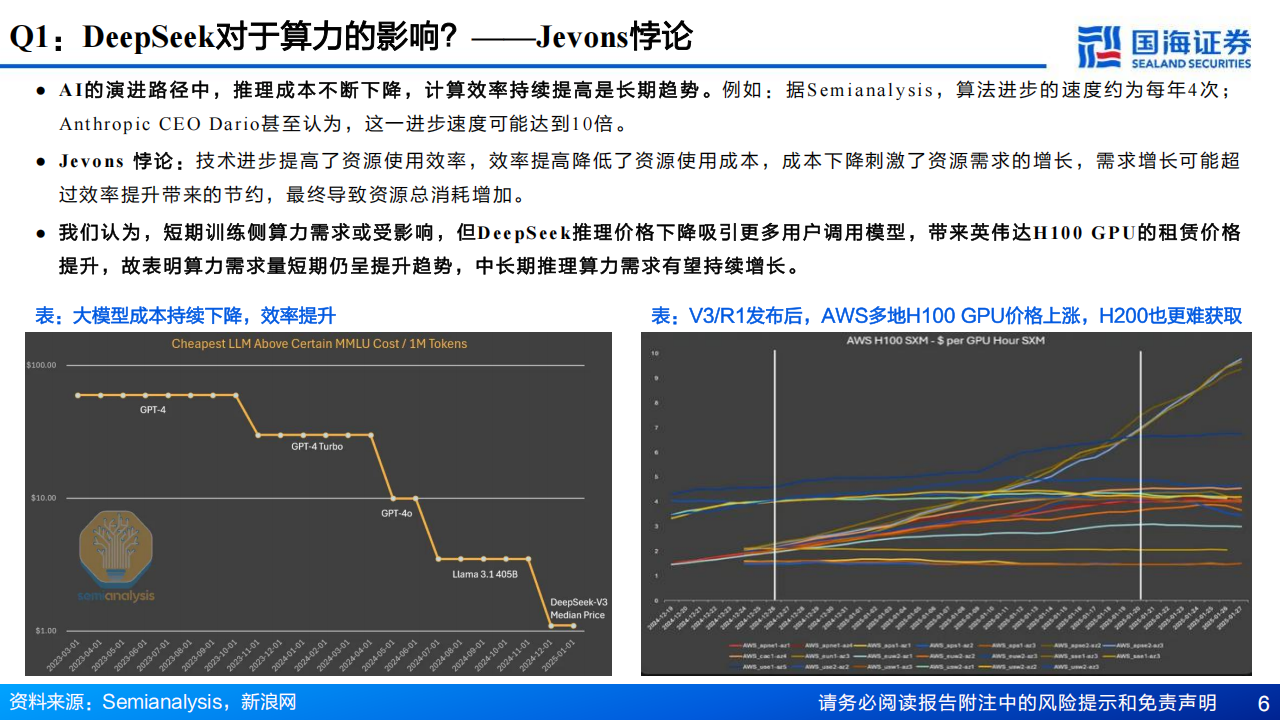

Q1:DeepSeek对于算力的影响?——Jevons悖论:短期训练侧算力需求或受影响,但DeepSeek推理价格下降吸引更多用户调用模型,带来英伟达H100 GPU的租赁价格提升,故表明算力需求量短期仍呈提升趋势,中长期推理算力需求有望持续增长。

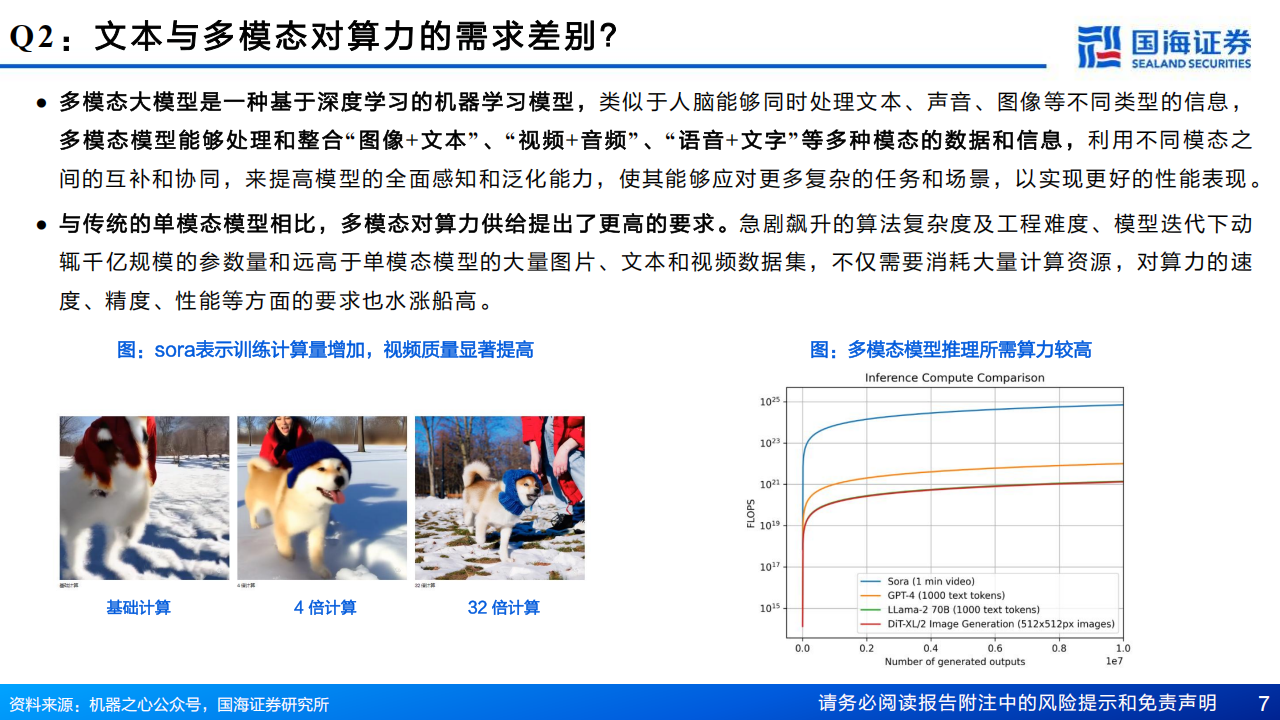

Q2:文本与多模态对算力的需求差别?——多模态模型大规模应用,或将升级算力需求。Sora将大模型训练数据从大规模的文本/图像,发展到视频数据,提升了新的维度,这或将数倍提升算力需求。

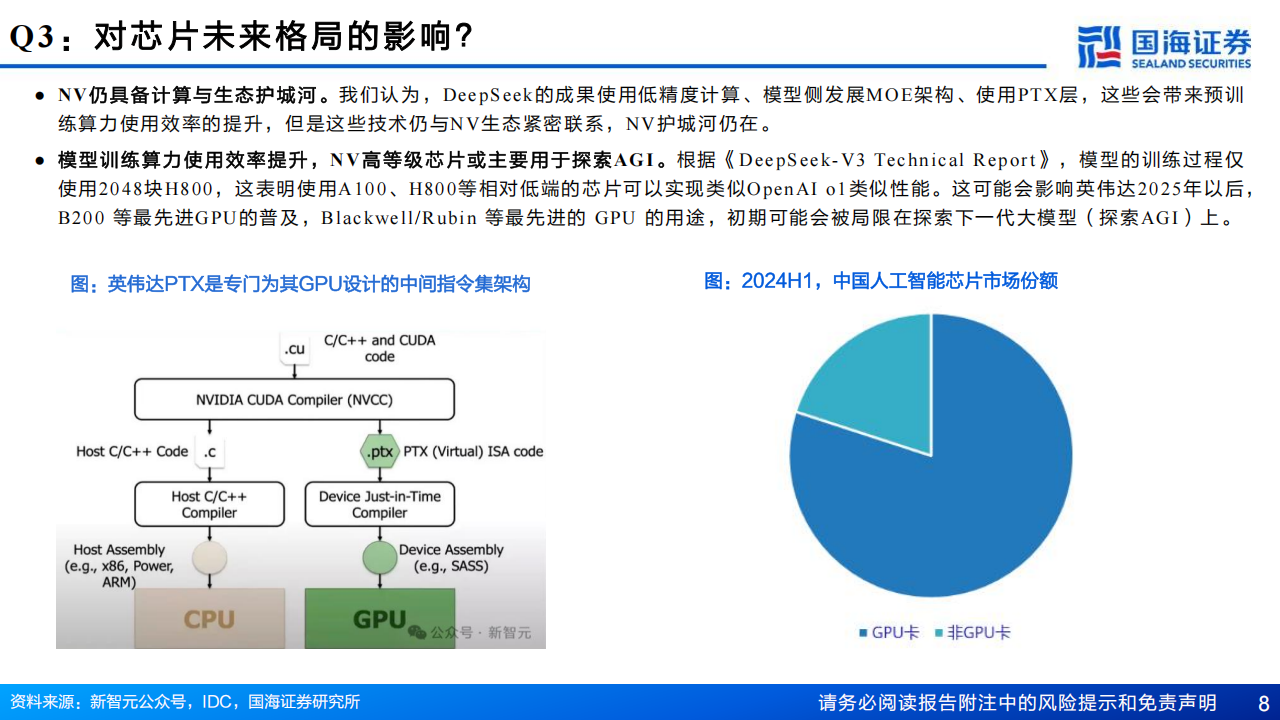

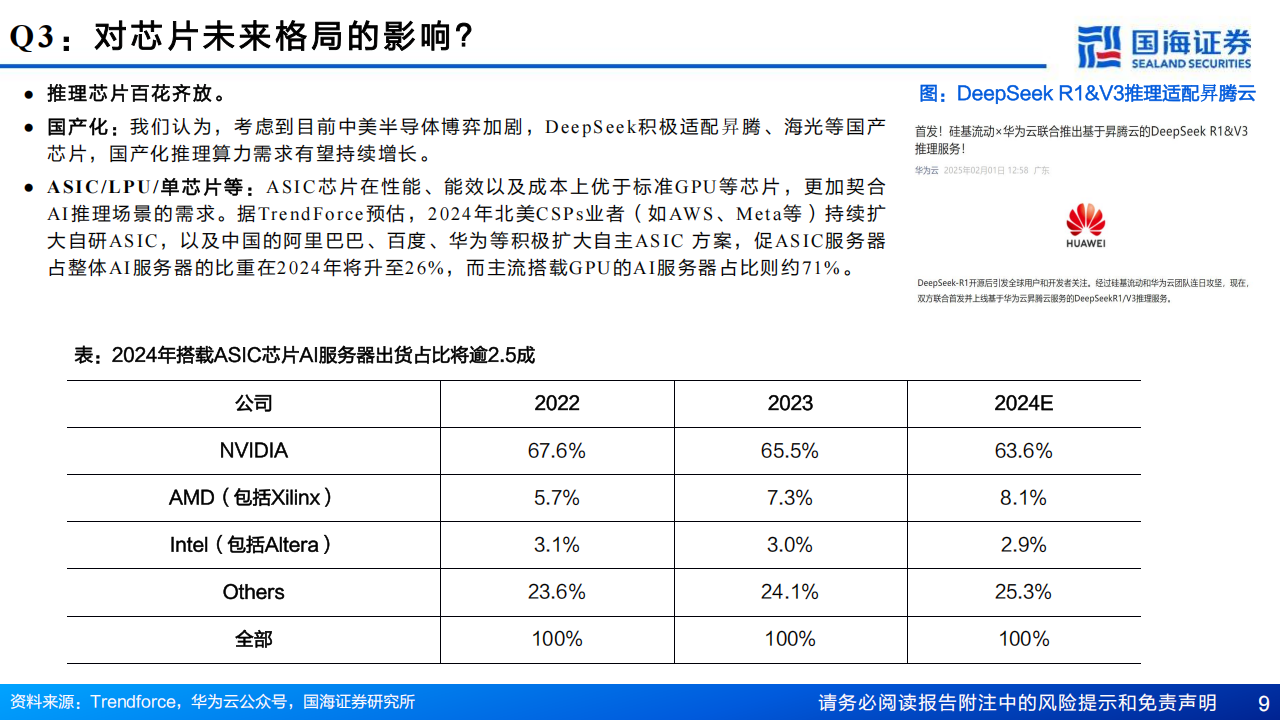

Q3:对芯片未来格局的影响?——训练:NV仍具备计算与生态护城河,DeepSeek带来模型训练算力使用效率提升,NV高等级芯片或主要用于探索AGI;推理:推理化、国产化、ASIC化为三大趋势。

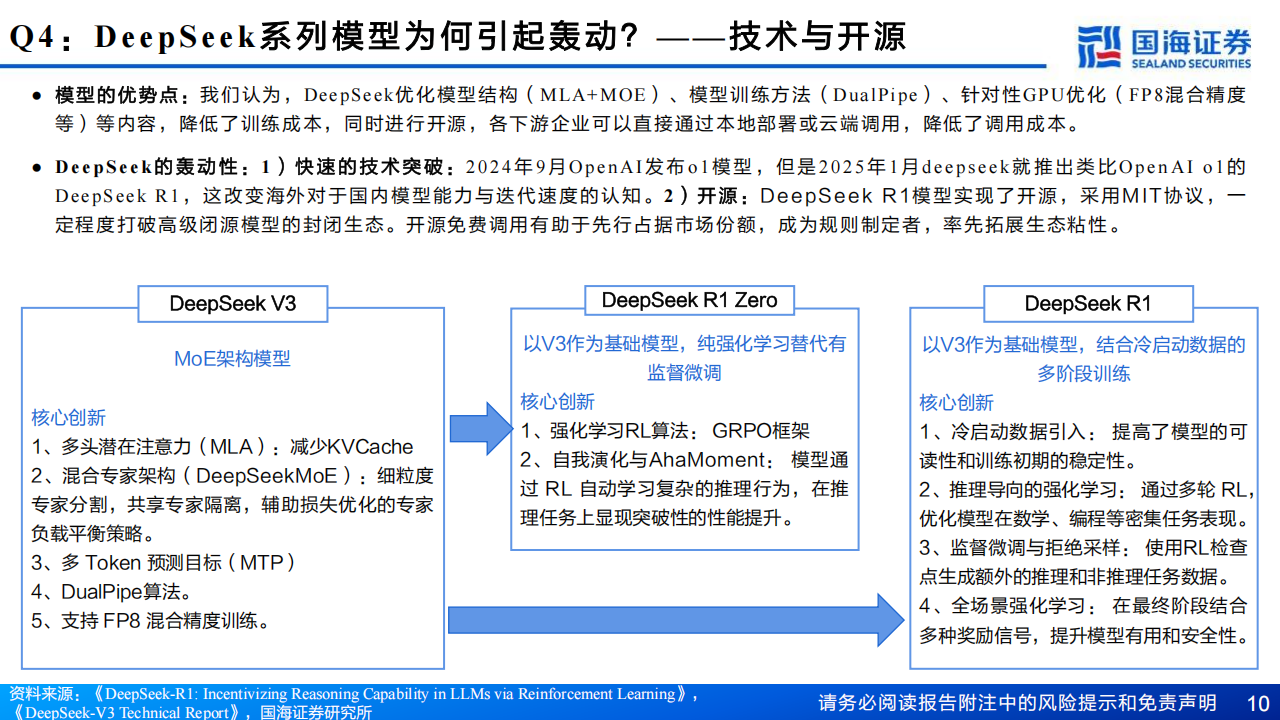

Q4:DeepSeek系列模型为何引起轰动?——技术与开源:DeepSeek优化模型结构(MLA+MOE、MTP)、模型训练方法(DualPipe)、针对性GPU优化(FP8混合精度等)等内容,降低了训练成本,同时进行开源,各下游企业可以直接通过本地部署或云端调用,降低了调用成本。

Q5:模型未来侧重Dense还是Sparse(MOE)?——一个通才(Dense)能够处理多个不同的任务,但一群专家(MoE)能够更高效、更专业地解决多个问题。

Q6:蒸馏模型的定义与发展潜力?——蒸馏可以减少原本大参数模型部署的硬件需求高、推理时间长、成本高昂的缺点,更有利于本地部署、推理业务、应用与端侧发展。

Q7:多模态的演进路径?——AI大模型技术和应用逐渐从文本扩展至更多模态。

Q8:DeepSeek发生后对应用侧的影响?——DeepSeek在推动降本、强推理等驱动下,有望加速AI应用普及度迎来跨越式提升。

Q9:DeepSeek发布对于端侧的影响?——DeepSeek决定支持用户进行“模型蒸馏”,已更新线上产品的用户协议,有望加速AI在端侧进程,未来手机、PC、小型设备等端侧或可部署。

Q10:北美增加Capex的用意,以及对deepseek的看法?——北美CSP厂商增加资本开支至服务器与数据中心,继续发展模型预训练与推理侧,重视deepseek技术与发展。